<오버피팅 방지 방법>

- data synthesize : 데이터를 더 생성시킴?

- data augment: 원본이미지를 변형시켜 다양한 데이터를 확보

- 미니 배치

- 피처 스케일링(stand~, normal~, minmax)

- dropout >>노드수에 맞게 일정노드를 제거함, 가중치도 약간 조정하는 역할도 한다

- data shuffling: 배치가 순서대로 되어있으면 학습할때 연관해서 학습하기 때문에 순서에 관계없이 학습하도록 순서를 바꿔줌

batch normalization (배치정규화): dropout보다 좋은 효과를 냄, 학습시간이 짧음 layer build시 사용

early stopping: 에러가 변화없는 경우, 가중치가 변하지 않는경우 > 학습이 다 되었다고 생각하고

model con 관찰 optimum 되는 지점을

CNN 기초

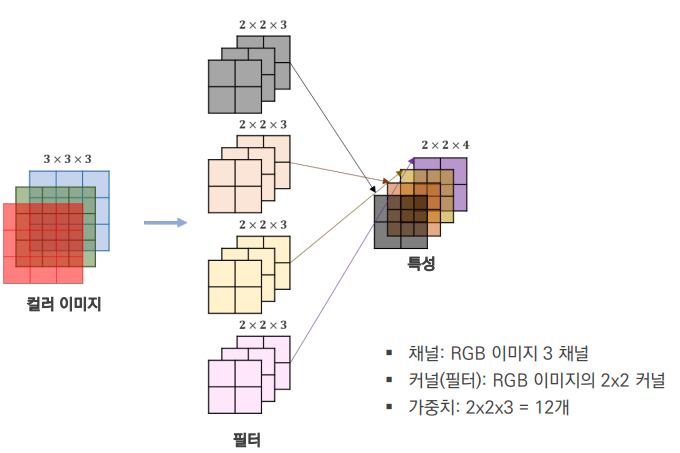

⭐⭐CNN 행렬 곱

$ 채널: RGB 이미지 3 채널

§ 커널(필터): RGB 이미지의 2x2 커널

§ 가중치: 2x2x3 = 12개

>> 이미지 채널 수(depth는 activation갯수만큼? 증가) 늘어나고 (차원?)사이즈는 줄어듦

원본이미지에서 rgb depth

컨볼루션 필터 사이즈 지정 가능

활성화 map이 만들어져서

작고 길게 만들어 주는게 최종 목표?

<stride>

합성곱 연산이 줄어들고

output형태가 줄어듦

>> stride : 점프

>> 사이즈 연산량 출력이 빨리나옴(시간 감소?) 줄어든다.

<padding>

이미지에서 가운데에 더 큰 가중치를 둠 (보통)

> 경계를 가중치를? 0으로 채워 둠

<convolution>

<pooling layer>

목표: down sampling

원리: (max) 4x4 2x2필터 이용

각 구간에서 최댓값을 뽑음

뎁스는 변화x

사이즈는 1/2이 됨 > b

-(max pooling) 최댓값

-(average pooling) 평균값

'Deep Learning' 카테고리의 다른 글

| [DL] AutoGrad (수정중) (0) | 2023.08.13 |

|---|---|

| [DL] rnn 과 lstm (수정중) (0) | 2023.08.10 |

| [DL] CNN_2 (0) | 2023.08.10 |

| [DL] 딥러닝 개요_2 (0) | 2023.08.08 |

| [DL] 딥러닝 개요_1 (0) | 2023.08.07 |